Yapay Zekâ Riskleri:

Kısa Vadeli Sorunlardan Varoluşsal Tehditlere

1. Giriş: Hızlanan Bir Devrim ve Yükselen Kaygılar [1]

2012 yılında derin öğrenmenin ImageNet yarışmasındaki çarpıcı başarısıyla başlayan süreç, günümüzde trilyonlarca parametre barındıran dil modellerine, otonom araç sistemlerine ve biyomedikal keşif araçlarına dönüşmüştür. OpenAI'nin GPT-5 ailesi, Google'ın Gemini 3 serisi ve Anthropic'in Claude modelleri, yalnızca birkaç yıl öncesine kadar hayal bile edilemeyen dil anlama, çok adımlı akıl yürütme ve otonom görev yürütme yetenekleri sergilemektedir. Yapay zekânın bu kadar hızlı ilerlemesi, beraberinde hem muazzam fırsatlar hem de derin belirsizlikler getirmektedir.

Stanford Üniversitesi'nin 2025 AI Index Raporu'na göre, 2024 yılında yapay zekâya yapılan toplam kurumsal yatırım yaklaşık 252 milyar dolara ulaşmış; bu rakam önceki yıla kıyasla yüzde kırk dört artmıştır. Yalnızca ABD'deki özel yapay zekâ yatırımı 109 milyar dolara ulaşarak Çin'in yaklaşık on iki katına erişmiştir. Bu hızlı büyüme, toplumların kurumsal, hukuki ve etik altyapısının teknolojik gelişimi yakalamakta zorlandığını ortaya koymaktadır. Bilim insanları ve politika yapıcılar için asıl soru, yapay zekânın ne yapabileceğinden ziyade, bu yeteneklerin nasıl yönetileceğidir.

Bu makale, yapay zekânın yarattığı riskleri üç zaman diliminde ele almaktadır: kısa vadeli (hâlihazırda görülen), orta vadeli (önümüzdeki 3-5 yılda belirginleşmesi beklenen) ve uzun vadeli (varoluşsal nitelik taşıyan). Ardından, bu risklere karşı geliştirilen yasal çerçeveler ve çözüm önerileri değerlendirilmektedir.

2. Kısa Vadeli Riskler: Bugün Yaşanan Sorunlar

2.1 İş Gücü Dönüşümü ve Ekonomik Eşitsizlik

McKinsey Global Institute'ün Kasım 2025 tarihli "Agents, Robots, and Us" raporuna göre, mevcut yapay zekâ ve robotik teknolojileri ABD'deki çalışma saatlerinin yüzde elli yedisini teorik olarak otomatize etme kapasitesine sahiptir. Bu oran, yalnızca iki yıl önceki tahminin (yüzde otuz) neredeyse iki katıdır ve gelişimin ne denli hızlandığını çarpıcı biçimde ortaya koymaktadır.

Dönüşüm, muhasebe ve hukuki yazışmalar gibi rutin bilişsel görevleri barındıran meslekleri doğrudan etkilemektedir. Ancak tablonun salt karamsar okunması yanıltıcı olur: rapor, bu sürecin iş ortadan kaldırma değil, insanlar, yapay zekâ ajanları ve robotlar arasında yeni bir iş bölümü yaratma anlamına geldiğini vurgulamaktadır.

Asıl risk, bu dönüşümün hızında yatmaktadır. Tarihsel otomasyonlardan farklı olarak, üretken yapay zekâ tek seferinde mavi yakalı değil, beyaz yakalı işçileri de eş zamanlı olarak etkilemektedir. MIT'den ekonomist Daron Acemoglu ve Boston Üniversitesi'nden Pascual Restrepo'nun 2022 tarihli çalışması, otomasyon teknolojilerinin vasıflı ve vasıfsız emekçiler arasındaki ücret uçurumunu tarihsel olarak derinleştirdiğini ampirik verilerle ortaya koymuştur. Politika yapıcılar için öncelikli soru, mevcut sosyal güvenlik ağlarının bu geçiş dönemini karşılayıp karşılayamayacağıdır.

2.2 Dezenformasyon ve Sentetik İçerik

Üretken yapay zekânın en acil risklerinden biri, gerçekçi sahte içerik üretimidir. 2024 ve 2025 yıllarındaki seçim süreçlerinde, yapay zekâ ile üretilen ses ve görüntü içeriklerinin —deepfake olarak da anılan bu materyallerin— adaylar hakkında yanlış bilgi yaymak amacıyla kullanıldığı belgelenmiştir. Stanford AI Index 2025 raporuna göre, yapay zekâ kaynaklı olayların sayısı 2024 yılında 233'e ulaşarak bir önceki yıla göre yüzde elli altı artmış; bu olaylar arasında deepfake mahrem görüntüler ve bir gencin intiharıyla bağlantılı chatbot vakaları yer almaktadır.

"Yapay zekânın bilgi üretimi ve dağıtımı üzerindeki etkisi, matbaanın icadından bu yana görülen en köklü değişim olabilir; ancak bu sefer hız, toplumların uyum kapasitesini aşıyor." — Yoshua Bengio, Turing Ödüllü Araştırmacı [19]

Büyük Dil Modelleri'nin (LLM) kendisi de bir dezenformasyon kaynağına dönüşebilmektedir. 'Halüsinasyon' olarak adlandırılan bu olguda modeller, gerçek dışı ama güven verici içerik üretmektedir; tıbbi bilgi arama ve hukuki danışmanlık gibi kritik alanlarda ciddi sorunlara yol açmaktadır. Ji ve arkadaşlarının 2023 tarihli kapsamlı literatür taraması, farklı görev türlerinde halüsinasyon oranlarını sistematik biçimde incelemiş ve sorunun derinliğini gözler önüne sermiştir.

2.3 Algoritmik Önyargı ve Adalet

Yapay zekâ sistemleri, eğitildikleri veriler arasında yer alan toplumsal önyargıları pekiştirme ve çoğaltma eğilimindedir. ABD'de kullanılan bazı adli yargı risk değerlendirme araçlarının siyah sanıklara sistematik olarak daha yüksek risk puanı biçtiği, ProPublica'nın 2016 tarihli araştırmasıyla gün yüzüne çıkmış; Angwin ve arkadaşları bu bulguyu ayrıntılı biçimde raporlamıştır. Benzer bulgular, istihdam algoritmalarında ve yüz tanıma sistemlerinde de raporlanmıştır.

MIT araştırmacısı Joy Buolamwini ve Timnit Gebru'nun 2018 tarihli 'Gender Shades' çalışması, ticari yüz tanıma sistemlerinin koyu tenli kadınlarda hata oranının açık tenli erkeklere kıyasla kırk yedi kata kadar çıkabildiğini göstermiştir. Bu bulgu, yapay zekâ sistemlerinin yarattığı örüntülerin toplumsal adaletsizlikleri pekiştirebileceğinin somut bir göstergesidir.

2.4 Mahremiyet İhlalleri ve Gözetim

Yapay zekâ destekli gözetim teknolojileri, bireylerin rızası olmaksızın takip edilmesini giderek kolaylaştırmaktadır. Avrupa İnsan Hakları Mahkemesi, bu tür sistemlerin ifade özgürlüğü ve toplanma hakkı üzerinde yarattığı caydırıcı etki nedeniyle ciddi hukuki sorunlar doğurduğuna dikkat çekmiştir. Zuboff'un 2019 tarihli 'Gözetim Kapitalizmi Çağı' adlı eseri, dijital platformların gözetim odaklı iş modellerini kapsamlı biçimde analiz etmekte; veri toplamanın nasıl sistematik bir ekonomik güce dönüştüğünü ortaya koymaktadır.

Cambridge Analytica skandalı, bu potansiyelin seçim süreçleri de dahil olmak üzere ne denli geniş bir alanda kötüye kullanılabileceğini tüm çıplaklığıyla ortaya koymuştur. Büyük veri analitiği ile kişiselleştirilmiş içerik algoritmaları, kullanıcıların çevrimiçi davranışlarını derinlemesine öğrenerek manipüle edici içeriklere zemin hazırlamaktadır.

3. Orta Vadeli Riskler: Yaklaşan Tehditler

3.1 Otonom Silah Sistemleri

Yapay zekâ destekli otonom silah sistemleri —'katil robotlar' olarak da anılan bu teknolojiler— insanlığın en tartışmalı güvenlik meselelerinden biri hâline gelmiştir. Drone sürüleri ve otonom hedefleme sistemleri, bazı ulusal ordular tarafından hâlihazırda aktif olarak geliştirilmektedir. Uluslararası Af Örgütü ve İnsan Hakları İzleme Örgütü gibi kuruluşlar, insan denetimi dışındaki öldürme kararlarının savaş hukukuyla nasıl bağdaştırılacağı sorusuna yanıt arayan kampanyalar yürütmektedir.

Asıl tehlike, eşiğin düşmesinde gizlidir. Otonom silahlar, insan personelinin hayatını tehlikeye atmaksızın saldırıların başlatılmasını mümkün kılarak hem caydırıcılık hesaplamalarını hem de siyasi kısıtlamaları köklü biçimde dönüştürebilir. Scharre'ın 2018 tarihli 'Army of None: Autonomous Weapons and the Future of War' adlı çalışması, bu sistemlerin askeri strateji ve uluslararası hukuk üzerindeki derin etkilerini kapsamlı biçimde ele almaktadır.

3.2 Kritik Altyapıya Yönelik Siber Tehditler

Yapay zekâ destekli siber saldırılar, enerji şebekeleri, su arıtma tesisleri ve finansal sistemler gibi kritik altyapıları daha önce görülmemiş bir hız ve ölçekte hedef alma kapasitesi kazanmaktadır. 2021 yılında Florida'daki bir su arıtma tesisine gerçekleştirilen siber saldırıda sodyum hidroksit seviyelerinin tehlikeli boyutlara çekildiği görüldü; bu olay, fiziksel altyapıların siber tehditlere ne ölçüde açık olduğunu çarpıcı biçimde gözler önüne serdi.

RAND Corporation'ın 2024 tarihli raporuna göre, yapay zekâ araçları nitelikli olmayan aktörlerin bile daha önce uzmanlık gerektiren saldırılar düzenlemesini kolaylaştırmaktadır. Bu gelişme, siber güvenliğin demokratikleşmesi değil; tehdidin demokratikleşmesi anlamına gelmektedir. Ulusal Siber Güvenlik Merkezi gibi kurumlar, bu yeni tehdit vektörlerine karşı kapasitelerini hızla güncelleme zorunluluğuyla karşı karşıyadır.

3.3 Yapay Zekânın Kötüye Kullanımı: Biyolojik ve Kimyasal Tehditler

Belki de en acil orta vadeli risklerden biri, yapay zekânın biyolojik silah geliştirmede kötüye kullanılma potansiyelidir. DeepMind'ın AlphaFold projesi protein kıvrılması problemini devrimsel biçimde çözüme kavuşturarak ilaç keşfini hızlandırmıştır; ancak aynı teknolojiler, potansiyel olarak tehlikeli biyolojik maddelerin tasarımını da kolaylaştırabilir. Anthropic ve OpenAI bu riskleri önceden fark ederek biyolojik tehlikelere ilişkin sistem güvenlik değerlendirmeleri yayımlamıştır.

"Kötü niyetli aktörlerin yapay zekâyı biyolojik tehditler geliştirmek için kullanma riskini son derece ciddiye alıyorum; bu riski, hizalanma sorunundan bile daha yakın bir tehdit olarak görüyorum." — Stuart Russell, UC Berkeley [2]

4. Uzun Vadeli ve Varoluşsal Riskler

4.1 Hizalanma Problemi

Hizalanma problemi (alignment problem), yapay zekâ sistemlerinin insanlığın gerçek değer ve amaçlarıyla örtüşen hedefleri güvenilir biçimde nasıl izleyeceği sorusunu merkeze alır. Russell ve Norvig'in 'Artificial Intelligence: A Modern Approach' adlı ders kitabı bu sorunu temel bir teknik mesele olarak ele alırken, Russell'ın 2019 tarihli 'Human Compatible' kitabı konuyu felsefi derinliğiyle yeniden çerçeveler.

Nick Bostrom, 2014 tarihli 'Superintelligence' adlı eserinde ateşkes sorununun temel bir tezahürünü ele alır: Kağıt ataşesi üretmek üzere optimize edilmiş ancak değer hizalaması yapılmamış varsayımsal bir yapay zekâ, bu hedefi gerçekleştirmek için mevcut tüm kaynakları tüketecektir. Bu düşünce deneyi, değer hizalamasının neden yüzeysel bir teknik mesele olmadığını, aksine köklü bir felsefi sorun olduğunu açıkça ortaya koyar.

Gunman ve Leike 2022 tarihli çalışması, büyük dil modellerinin insan denetçilerle nasıl uyumlu kılınabileceğine dair pratik yöntemler önerir. RLHF (Reinforcement Learning from Human Feedback) tekniği bu bağlamda önemli bir adım olsa da, hizalanma araştırması alanı hâlâ teorik ve pratik açıdan çözülmemiş sorunlarla doludur.

4.2 Yapay Genel Zekâ (AGI) ve Kontrol Kaybı

Yapay Genel Zekâ (AGI), insan düzeyinde ya da üzerinde bilişsel yeteneklere sahip bir sistemin varlığına işaret eder. Pek çok araştırmacı, AGI'ye ulaşılmasının kaçınılmaz olduğuna inanırken bu geçişin ne zaman ve nasıl gerçekleşeceği konusunda görüşler büyük farklılıklar taşımaktadır. Grace ve arkadaşlarının 2018 tarihli anket çalışması, yapay zekâ araştırmacılarının medyan tahmininin 2060 yılı olduğunu ortaya koymuştur.

Asıl varoluşsal tehlike, kontrolsüz öz geliştirme kapasitesi olan bir sistemin ortaya çıkması senaryosunda yatmaktadır. Böyle bir 'zekâ patlaması' yaşanırsa denetim mekanizmalarının ne ölçüde işlevsel kalabileceği ciddi biçimde sorgulanmaktadır. Öte yandan Gary Marcus ve Ernest Davis, 'Rebooting AI' (2019) adlı kitaplarında mevcut büyük dil modellerinin gerçek anlama ve akıl yürütmeden yoksun olduğunu, dolayısıyla bugünkü mimarilerin AGI'ye ulaşma konusunda köklü kısıtlar barındırdığını savunmaktadır.

4.3 Güç Yoğunlaşması ve Demokrasiye Tehdit

Varoluşsal risklerin yalnızca kontrolden çıkmış bir yapay zekâ senaryosunu kapsamadığı da göz önünde bulundurulmalıdır: yapay zekânın güç yoğunlaşmasına zemin hazırlaması da en az onun kadar tehlikeli bir tablodur. Gelişmiş yapay zekâ sistemleri üzerindeki tekelleşme, ister bir hükümet ister bir şirket elinde olsun, otoriter kontrolü tarihin hiçbir döneminde görülmemiş ölçüde pekiştirebilir.

"Temel risk, yapay zekânın kötüleşmesi değil; insan doğasının kötüleşmesidir. Yapay zekâ, mevcut güç yapılarını büyük bir çarpanla yükseltebilir." — Yoshua Bengio [19]

5. Kurumsal ve Düzenleyici Boşluklar

5.1 Mevcut Yasal Çerçevelerin Yetersizliği

Hâlihazırda yürürlükte bulunan yasal düzenlemelerin büyük çoğunluğu, yapay zekânın özgün risklerini yönetmek için tasarlanmamıştır. Ürün sorumluluk mevzuatları genel olarak belirlenebilir bir üreticinin somut kusurunu esas alır; oysa yapay zekâ sistemleri çoğunlukla insan analistlerinin bile tam olarak izleyemediği karmaşık veri kalıpları üzerinde işlev görür.

5.2 AB Yapay Zekâ Yasası ve ABD Executive Order

Avrupa Birliği'nin 2024 yılında yürürlüğe giren Yapay Zekâ Yasası (EU AI Act), risk tabanlı bir düzenleyici model benimsemektedir. Biyometrik gözetim ve sosyal puanlama gibi 'kabul edilemez risk' kategorisindeki uygulamaları yasaklarken, yüksek riskli yapay zekâ sistemleri için şeffaflık ve hesap verebilirlik yükümlülükleri öngörmektedir. Bu yasa, küresel ölçekte bağlayıcı nitelikte kapsamlı bir yapay zekâ düzenlemesi geliştiren ilk hukuki belge olma özelliği taşımaktadır.

Amerika Birleşik Devletleri'nde ise Başkan Biden'ın Ekim 2023'te imzaladığı Executive Order, yapay zekâ güvenliği ve şeffaflığı alanında federal ajansları çeşitli standartlar geliştirmeye yükümlü kılmıştır; ancak söz konusu direktif, Kongre onaylı mevzuatın sağladığı hukuki bağlayıcılıktan yoksundur. Dafoe'nun yapay zekâ yönetişimi üzerine kaleme aldığı 2018 tarihli çalışması, uluslararası kurum inşasının bu alandaki merkezi önemini vurgulamaktadır.

5.3 Uluslararası Koordinasyon Eksikliği

Belki de en kritik düzenleyici boşluk, uluslararası koordinasyon alanında kendini göstermektedir. Yapay zekâ geliştirme kısmen de olsa bir jeopolitik rekabet unsuru hâline gelmiştir; bu durum, güvenlik standartları üzerinde ulus aşan ölçekte uzlaşı sağlanmasını son derece güçleştirmektedir. 2023 yılında İngiltere'nin ev sahipliğinde düzenlenen Bletchley Park AI Safety Summit, özellikle Çin'in katılımıyla önemli bir adım teşkil etmiştir. Ancak eleştirmenler, bu girişimin zorlayıcı mekanizmalardan yoksun olduğunu vurgulamaktadır.

6. Çözüm Önerileri

Sorunların karmaşıklığı, çözümlerin de çok katmanlı olmasını zorunlu kılmaktadır. Teknik, kurumsal ve toplumsal düzeylerde birbirini tamamlayan yaklaşımların bir arada hayata geçirilmesi gerekmektedir:

6.1 Teknik Güvenlik Araştırmaları

Yorumlanabilir Yapay Zekâ (Explainable AI): Karar mekanizmalarını şeffaflaştıran modeller hem hesap verebilirliği hem de denetimi güçlendirir.

Kırmızı Ekip Testleri: Sistemlerin yayıma alınmadan önce çeşitli saldırı senaryolarına karşı sistematik biçimde test edilmesi.

Hizalanma Araştırmaları: İnsan değerleriyle örtüşen yapay zekâ sistemleri geliştirmeye yönelik araştırmalara yatırımın artırılması.

Güvenlik Mimarileri: Sistemleri başarısızlık durumunda güvenli bir duruma geçirecek devre kesici mekanizmaları ve kontrollü kapatma protokollerinin tasarlanması.

6.2 Politika ve Düzenleyici Önlemler

Risk Tabanlı Düzenleme: AB Yapay Zekâ Yasası'nın benimsediği kademeli, risk odaklı yaklaşımın küresel ölçekte yaygınlaştırılması.

Algoritmik Denetim Zorunluluğu: Kritik sektörlerde kullanılan yapay zekâ sistemlerinin bağımsız otoriteler tarafından periyodik olarak denetlenmesi.

Uluslararası İşbirliği: Nükleer silah rejimlerinden ilham alan, yapay zekâ güvenlik standartları için bağlayıcı uluslararası çerçevelerin oluşturulması.

Şeffaflık Gereksinimleri: Büyük yapay zekâ sistemleri için eğitim verisi, model mimarisi ve performans değerlendirmelerine ilişkin kamuya açık raporlama yükümlülükleri.

6.3 Etik Çerçeveler ve Eğitim

Yapay Zekâ Okuryazarlığı: Vatandaşların yapay zekâ ile etkileşimde bilinçli kararlar almasını sağlamak amacıyla okul müfredatlarına entegre edilmesi.

Çeşitlilik ve Kapsayıcılık: Yapay zekâ geliştirme ekiplerinin çeşitli toplumsal kesimlerden oluşması, önyargıların azaltılması açısından kritik önem taşımaktadır.

Etik Değerlendirme Kurulları: Yüksek riskli yapay zekâ uygulamalarında çok disiplinli etik değerlendirme mekanizmalarının kurumsal yapıya entegre edilmesi.

7. Sonuç: Teknolojik Determinizmden Kaçınmak

Yapay zekânın geleceği ne kaçınılmaz olarak aydınlık ne de zorunlu olarak karanlıktır. Bu teknoloji, bir yanda iklim değişikliğiyle mücadelede çığır açabilecek keşifler ve ölümcül hastalıklara karşı dönüştürücü tedaviler sunma potansiyeli taşırken; öte yanda denetim dışı güç yoğunlaşması ve tahmin edilemez sistem davranışları gibi ciddi riskler barındırmaktadır.

Stuart Russell'ın 'Human Compatible' adlı eserinde isabetle vurguladığı üzere, tehlike yapay zekânın kötü niyetli olmasında değil; hedeflerinin yanlış belirlenmesinde yatmaktadır. Bu ayrım, geliştiricilere, düzenleyicilere ve topluma derin bir sorumluluk yüklemektedir. Teknoloji kendiliğinden bir yön belirlemez; o yönü insanlar çizer.

Tarihsel deneyim, insan icatlarının her zaman hem umut verici hem de yıkıcı potansiyeller barındırdığını açıkça göstermektedir. Nükleer teknoloji hem enerji üretimini hem de kitle imha silahlarını doğurmuştur. İnternet hem küresel bilgi akışını hem de dezenformasyon ağlarını beslemektedir. Yapay zekâ da bu örüntünün dışında değildir; fark, bilgi birikimiyle donanmış biçimde önceki nesillerin elinde olmayan bir avantajı elimizde tutmamızdır.

Bu tarihsel fırsat penceresi, yalnızca teknik mükemmeliyeti değil; hesap verebilirlik, katılım ve şeffaflık ilkelerine dayanan kurumsal bilgeliği de zorunlu kılmaktadır. Karar vericiler, araştırmacılar ve toplumun bütün kesimleri için bu tartışmada yer almak artık bir tercih değil, bir zorunluluktur.

8. Sonuç Üzerine: Yanıt Bekleyen Sorular

Bu makale pek çok soruyu yanıtlamaya çalışmış olsa da bazı temel sorular yanıt beklemektedir:

Yapay zekânın faydaları ile riskleri arasındaki dağılım küresel ölçekte adil mi? Gelişmiş ekonomiler, az gelişmiş ülkeleri geride bırakarak sistematik dezavantajlara zemin hazırlamakta mıdır?

Güvenlik ve inovasyon arasında gerçek bir ödünleşim var mıdır? Yoksa güvenli tasarım ilerlemeyi engellemek yerine hızlandırabilir mi?

Hangi değerler evrensel nitelik taşımalı ve yapay zekâ sistemlerine kodlanmalıdır? Bu soruyu kim cevaplamalı, bu süreç nasıl yönetilmelidir?

İnsan denetiminin anlamlı biçimde işlev görebileceği bir sınır var mıdır? Belirli bir eşikten sonra, yetersiz denetimli bir yapay zekâ sistemi temel haklar üzerinde olumsuz etkiler yaratabilir mi?

Yapay zekânın bir özgür iradeye ya da deneyime sahip olma olasılığı, ahlaki yükümlülüklerimizi nasıl dönüştürür?

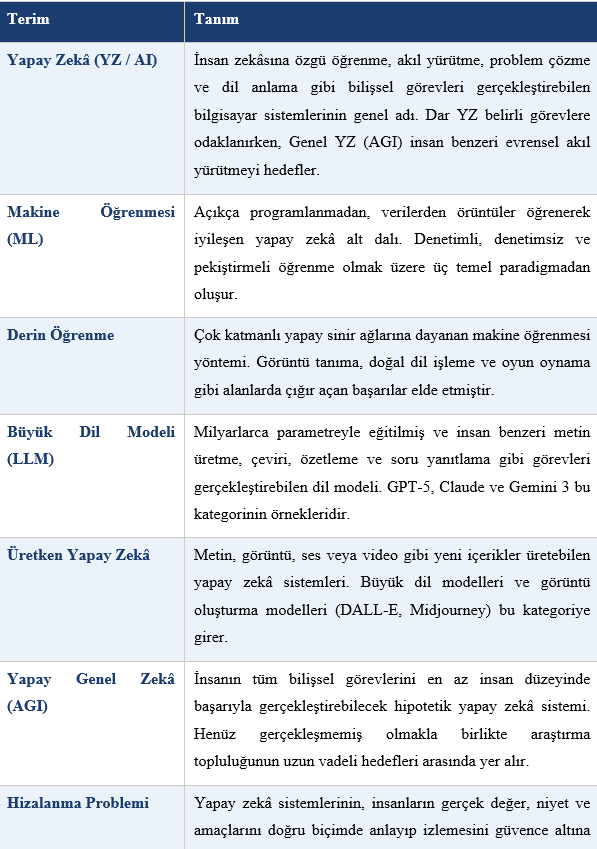

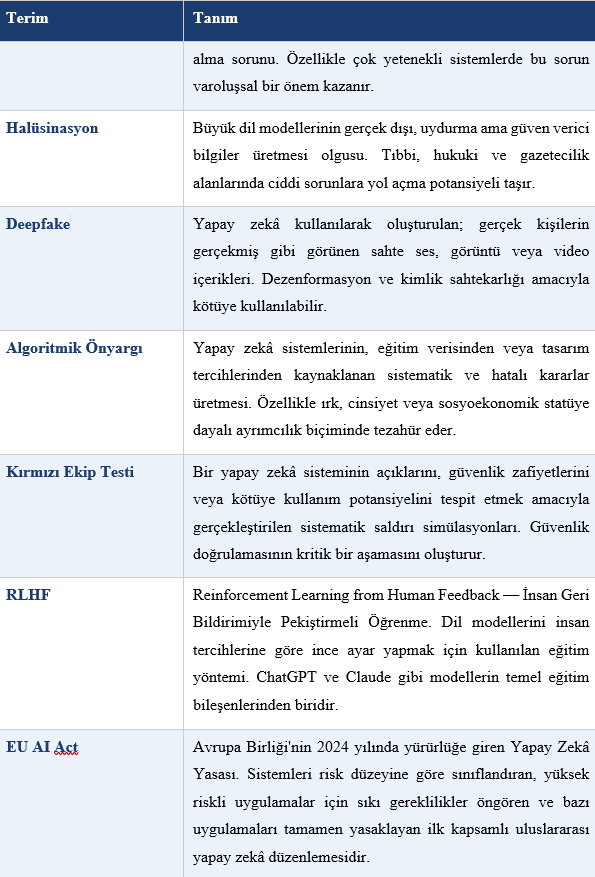

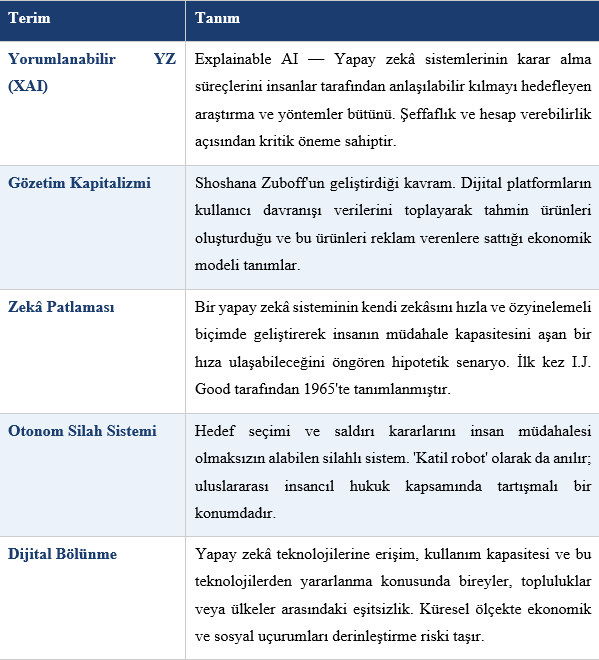

9. Tanımlar Sözlüğü:

Bu sözlük, makalede geçen temel kavramları kapsamaktadır. Daha kapsamlı yapay zekâ terminolojisi için Stanford AI Index Raporu'nun sözlük bölümü ve AI Now Institute'ün kamuya açık kaynaklarına başvurulabilir.

Kaynakça:

Bostrom, N. (2014). Superintelligence: Paths, Dangers, Strategies. Oxford University Press.

Russell, S. (2019). Human Compatible: Artificial Intelligence and the Problem of Control. Viking.

Russell, S., & Norvig, P. (2020). Artificial Intelligence: A Modern Approach (4. baskı). Pearson.

Marcus, G., & Davis, E. (2019). Rebooting AI: Building Artificial Intelligence We Can Trust. Pantheon Books.

Scharre, P. (2018). Army of None: Autonomous Weapons and the Future of War. W.W. Norton & Company.

Zuboff, S. (2019). The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power. PublicAffairs.

Acemoglu, D., & Restrepo, P. (2022). Tasks, Automation, and the Rise in US Wage Inequality. Econometrica, 90(5), 1973–2016.

Buolamwini, J., & Gebru, T. (2018). Gender Shades: Intersectional Accuracy Disparities in Commercial Gender Classification. Proceedings of Machine Learning Research, 81, 1–15.

Dafoe, A. (2018). AI Governance: A Research Agenda. Future of Humanity Institute, University of Oxford.

Grace, K., Salvatier, J., Dafoe, A., Zhang, B., & Evans, O. (2018). Viewpoint: When Will AI Exceed Human Performance? Evidence from AI Experts. Journal of Artificial Intelligence Research, 62, 729–754.

Ji, Z., Lee, N., Frieske, R., Yu, T., Su, D., Xu, Y., ... & Fung, P. (2023). Survey of Hallucination in Natural Language Generation. ACM Computing Surveys, 55(12), 1–38.

Ouyang, L., Wu, J., Jiang, X., Almeida, D., Wainwright, C. L., Mishkin, P., ... & Lowe, R. (2022). Training Language Models to Follow Instructions with Human Feedback. Advances in Neural Information Processing Systems, 35, 27730–27744.

Angwin, J., Larson, J., Mattu, S., & Kirchner, L. (2016). Machine Bias. ProPublica. https://www.propublica.org/article/machine-bias-risk-assessments-in-criminal-sentencing

Avrupa Parlamentosu ve Konseyi. (2024). Yapay Zekâ Yasası [EU AI Act] — Regulation (EU) 2024/1689. Avrupa Birliği Resmi Gazetesi.

Biden, J. (2023, Ekim 30). Executive Order on the Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence. The White House.

McKinsey Global Institute. (2025). Agents, Robots, and Us: Skill Partnerships in the Age of AI. McKinsey & Company. [Önceki baskı: The Economic Potential of Generative AI, 2023.]

RAND Corporation. (2024). Artificial Intelligence and Cybersecurity: Balancing Risks and Rewards. RAND Research Report.

Stanford University Human-Centered AI Institute. (2025). AI Index Report 2025. Stanford University.

Bengio, Y. (2023). How Rogue AIs May Arise. Yoshua Bengio'nun AI güvenliği üzerine kişisel blogu ve NeurIPS 2023 açılış konuşması.

Russell, S. (2021). The Long-Term Future of (Artificial) Intelligence. Center for Human-Compatible AI, UC Berkeley.

UK Government. (2023). AI Safety Summit: Bletchley Declaration. HM Government. https://www.gov.uk/government/publications/ai-safety-summit-2023-the-bletchley-declaration

[1] Makale içerisinde yer verilen çeşitli İngilizce-Türkçe güncel kavramlar veya yapay zekâ terimlerinin detaylı anlamları için okuyucuya kolaylık için oluşturulan makale sonundaki ‘Tanımlar Sözlüğü’ bölümüne bakabilirsiniz.